Estudo mostra que 70% das empresas preveem que ataques de deepfake criados por IA terão alto impacto e avançam no uso da biometria para combater esse risco crescente

- 62% dos entrevistados temem que sua organização não esteja levando a ameaça dos deepfakes a sério o suficiente

- 73% das organizações pesquisadas estão implementando soluções de segurança cibernética para lidar com a ameaça de deepfakes

- 75% das soluções implementadas para lidar com deepfakes são soluções biométricas

A aumento do risco global de deepfakes fez acender o sinal de alerta das empresas. Uma pesquisa da iProov, fornecedora líder em fornecimento de soluções de identidade biométrica baseadas em ciência, realizada no primeiro semestre de 2024 junto a 500 executivos de diversos setores e países, revela que quase metade das organizações (47%) afirma já ter enfrentado deepfakes e outros 70% dos executivos entrevistados dizem acreditar que os ataques deepfake criados utilizando ferramentas de IA generativas terão um alto impacto em suas organizações.pesar disso, dois terços das organizações, ou 68%, acreditam que, embora seja impactante na criação de ameaças à segurança cibernética, 84% acham que a IA generativa é fundamental na proteção contra elas. Além disso, a pesquisa revelou que 75% das soluções que estão sendo implementadas nas empresas para lidar com a ameaça do deepfake são biométricas.

O estudo The Good, The Bad and The Ugly, divulgado nesta quarta-feira (14/08), ouviu 500 tomadores de decisões de tecnologia de empresas globais localizadas no Brasil, Reino Unido, EUA, Austrália, Nova Zelândia e Cingapura sobre a ameaça da IA generativa e dos deepfakes.

“Observamos deepfakes há anos, mas o que mudou nos últimos 6 a 12 meses é a qualidade e a facilidade com que elas podem ser criadas e seu poder de causar destruição em larga escala para organizações e indivíduos”, afirma Andrew Bud, fundador e CEO da iProov. “Talvez o uso mais negligenciado de deepfakes seja a criação de identidades sintéticas que, por não serem reais e não terem dono para relatar seu roubo, passam despercebidas, enquanto causam estragos e fraudam organizações e governos em milhões de dólares.”

Embora as organizações reconheçam o ganho em eficiência proporcionado pela Inteligência Artificial, esses benefícios também são aproveitados por aqueles que criam as tecnologias por trás das ameaças à segurança digital. A pesquisa da iProov mostra que quase três quartos (73%) das organizações estão implementando soluções para lidar com a ameaça de deepfake, mas sua confiança ainda é baixa, com 62% dos entrevistados revelando a preocupação de que suas empresas não estão levando as ameaças de deepfakes a sério o suficiente.

Ainda assim, a pesquisa mostra o reconhecimento por parte das organizações de que as deepfakes são uma ameaça real e presente, que podem ser usadas contra pessoas de várias maneiras, tais como difamação e danos à reputação, embora o risco mais quantificável seja na fraude financeira. Isso inclui, por exemplo, seu uso para cometer fraude de identidade em larga escala, personificando indivíduos para obter acesso não autorizado a sistemas ou dados, iniciar transações financeiras ou enganar outras pessoas para o envio de dinheiro na escala do recente golpe deepfake em Hong Kong. A dura realidade é que as deepfakes representam uma ameaça a qualquer situação em que um indivíduo precise verificar sua identidade remotamente, e os entrevistados apontam que as organizações não estão se preocupando como deveriam.

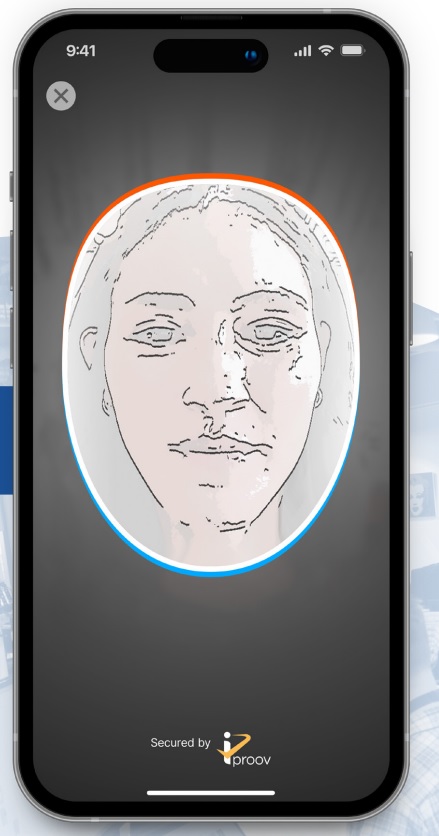

“Apesar do que alguns podem acreditar, agora é impossível para o olho nu detectar deepfakes de qualidade. Embora a pesquisa revele que metade das organizações pesquisadas tenha encontrado deepfakes, a probabilidade é que esse número seja muito maior porque a maioria das organizações não está devidamente equipada para identificá-las corretamente”, ressalta o CEO da iProov. “Com o ritmo rápido em que o cenário de ameaças está inovando, as organizações não podem se dar ao luxo de ignorar as metodologias de ataque resultantes e como a biometria facial se destacou como a solução mais resiliente para verificação remota de identidade”, acrescenta Andrew Bud.

Diferenças regionais

O estudo da iProov mostra que a questão das deepfakes tem percepções diferentes dependendo da região do mundo. Organizações da Ásia-Pacífico – APAC (51%), europeias (53%) e da América Latina (53%) são significativamente mais propensas do que as da América do Norte (34%) a dizerem que encontraram uma deepfake, enquanto aquelas localizadas na APAC (81%), Europa (72%) e na América do Norte (71%) são significativamente mais propensas do que organizações da América Latina (54%) a acreditarem que ataques de deepfake terão um impacto em suas organizações.

Em meio ao terreno de constante mudança no cenário de ameaças, as táticas empregadas para violar organizações geralmente refletem aquelas usadas em fraudes de identidade. Sem surpresa, as deepfakes agora estão empatados em terceiro lugar entre as preocupações que mais prevalecem entres os entrevistados, com a seguinte ordem: violações de senha (64%), ransomware (63%), ataques de phishing/engenharia social (61%) e deepfakes (61%).

A IA não é totalmente ruim

Existem muitos tipos diferentes de deepfakes, mas todos eles têm um denominador comum: são criados usando ferramentas de IA generativa. As organizações reconhecem que a IA generativa é inovadora, segura, confiável e as ajuda a resolver problemas, além de ser vista como mais ética do que antiética, com previsão de impacto positivo no futuro. Por isso, estão tomando medidas para usufruir delas, pois somente 17% não conseguiram aumentar seu orçamento em programas que abrangem o risco da IA. Além disso, a maioria introduziu políticas sobre o uso de novas ferramentas de IA.

A biometria lidera a luta contra os deepfakes

A biometria surgiu como a solução preferida das organizações para lidar com a ameaça das deepfakes, que se declararam mais propensas a usar biometria facial e impressão digital, ainda que o tipo de biometria possa variar com base nas tarefas. Por exemplo, o estudo descobriu que as organizações consideram a biometria facial o modo adicional mais apropriado de autenticação para proteger contra deepfakes para acesso/login de conta, alterações de dados pessoas e transações típicas.

Software não é suficiente

O estudo deixa claro que as organizações veem a biometria como uma área de especialização, com quase todos (94%) concordando que um parceiro de segurança biométrica deve ser mais do que apenas um produto de software. As organizações pesquisadas declararam que estão procurando um provedor de soluções que evolua e acompanhe o cenário de ameaças com monitoramento contínuo (80%), biometria multimodal (79%) e detecção de vivacidade (77%), todos com destaque em seus requisitos para proteger adequadamente as soluções biométricas contra deepfakes.

Metodologia

A pesquisa The Good, The Bad, and The Ugly foi desenvolvida no primeiro semestre de 2024 em colaboração com a Hanover Research, e ouviu 500 entrevistados globais recrutados em setores como Bancos, Comércio Eletrônico, Finanças e Contabilidade, Saúde/Médica, Hospitalidade, Seguros, Varejo, Telecomunicações e Viagens. Os entrevistados eram profissionais em TI, Operações, Segurança de Rede, Tecnologia, Experiência Digital, Gestão de Riscos ou departamento de Gestão de Produtos com responsabilidade primária de tomada de decisão na seleção e compra de soluções de tecnologia para sua organização.

Veja também:

- A evolução da segurança digital no ambiente industrial

- Setor de tecnologia foi o mais afetado por ataques cibernéticos

- O papel do hacktivismo no conflito político

- Aumenta o índice de impacto do malware que mais rouba dados e senhas no Brasil

- Cibercrime usa IA para ampliar ameaças

- IEEE ensina como detectar vídeos falsos e preservar privacidade

- 15% das empresas brasileiras negligenciam treinamento em cibersegurança

- Segurança Cibernética em Smart Cities

- Grande backdoor em milhões de cartões RFID permite clonagem instantânea

- Aumento de 150% nas VPNs no Brasil após o fechamento do X

- Ataques de VPN só aumentarão

- Programa Avança Tech da Pref. SP lança novos Cursos Gratuitos

3 Trackbacks / Pingbacks