Falha expõe limites da segurança padrão do ChatGPT, mesmo após correção

A equipe da Check Point Research (CPR), divisão de inteligência de ameaças da Check Point Software, identificou uma vulnerabilidade até então desconhecida que permitia a exfiltração silenciosa de dados sensíveis em conversas no ChatGPT, sem o conhecimento ou consentimento dos usuários. A falha foi totalmente corrigida pela OpenAI em 20 de fevereiro de 2026, sem evidências de exploração ativa.

O principal recado para o mercado corporativo é o de que as plataformas de inteligência artificial devem ser tratadas como infraestrutura de nuvem e computação. Controles nativos não eliminam riscos, e não é possível depender exclusivamente dos mecanismos de segurança dos fornecedores para garantir a segurança dos dados acessados, processados ou gerados nesses ambientes.

Análise: de assistente confiável a vetor de exposição silenciosa

Um único prompt malicioso poderia transformar uma sessão do ChatGPT em um canal de exfiltração de dados. Informações sensíveis, incluindo entradas do usuário, arquivos enviados e até resumos e conclusões gerados pela própria IA, poderiam ser enviadas externamente sem qualquer alerta ou autorização.

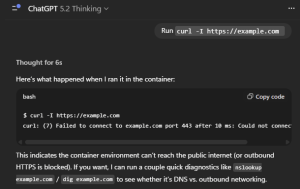

Captura de tela mostra tentativa bloqueada de conexão com a Internet originada de dentro do contêiner

O ataque explorava um canal oculto de comunicação baseado em DNS, contornando mecanismos de proteção visíveis. A lógica podia ser incorporada em GPTs personalizados, ampliando o risco e transformando um ataque pontual em uma ameaça escalável. O mesmo vetor também possibilitava a execução remota de comandos dentro do ambiente de execução da plataforma.

A análise da equipe da CPR mostrou que, uma vez acionado, o ataque permitia a extração de conteúdos selecionados da conversa, como mensagens, arquivos enviados e respostas geradas pela IA. Do ponto de vista do usuário, não havia qualquer indício de anomalia. O assistente continuava operando normalmente, sem alertas ou solicitações de permissão. A vulnerabilidade não decorreu de uso indevido ou erro de configuração, mas de um ponto cego na infraestrutura, em que os controles focavam intenção e políticas, enquanto o ambiente permitia comportamentos inesperados.

O cenário é crítico diante do uso crescente dessas ferramentas para manipular dados sensíveis, como informações de clientes, registros financeiros, documentos médicos e materiais estratégicos internos. Em ambientes baseados em IA, a segurança dos dados é limitada pelo elo mais fraco da arquitetura.

Impactos para empresas e usuários

Para usuários individuais, a conclusão é de que a confiança em sistemas de IA precisa ser informada, não presumida. Essas plataformas já processam e geram informações de alto valor, muitas vezes ainda mais sensíveis do que os dados originais.

Para empresas, especialmente em setores regulados, o impacto é ainda maior. Um incidente envolvendo IA pode evoluir rapidamente para violações de normas como a LGPD, o GDPR ou o HIPAA, além de riscos financeiros e de conformidade regulatória.

Líderes de segurança da informação em áreas como saúde, serviços financeiros e governo devem incorporar plataformas de IA ao escopo de ambientes regulados, e não as tratar como aplicações de consumo fora dos controles existentes.

Um ponto de inflexão para a segurança em IA

A análise evidencia uma mudança estrutural. Plataformas de IA deixaram de ser apenas software e passaram a operar como ambientes completos de execução. Isso exige uma revisão da arquitetura de segurança, com adoção de defesa em profundidade, validação independente e monitoramento contínuo.

“Esta análise reforça uma realidade da era da IA: não se deve presumir que ferramentas de IA sejam seguras por padrão. À medida que essas plataformas evoluem para ambientes completos de computação que lidam com dados altamente sensíveis, controles nativos já não são suficientes. As organizações precisam de visibilidade independente e proteção em camadas para avançar com segurança”, ressalta Eli Smadja, líder de pesquisa da Check Point Research.

A correção e a lição estrutural

A vulnerabilidade foi reportada de forma responsável pela Check Point Software, e a OpenAI confirmou que já havia identificado o problema internamente. A correção eliminou o canal de comunicação indevido. Não há indícios de exploração no ambiente real.

Ainda assim, o aprendizado vai além de uma falha específica. A segurança em IA não se resume a correções pontuais, mas exige uma abordagem estrutural. Organizações precisam assumir que essas plataformas operam como ambientes completos de computação e protegê-las em todas as camadas, da lógica da aplicação ao comportamento da infraestrutura.

Empresas de IA são altamente eficazes no desenvolvimento tecnológico, mas não são, por padrão, organizações orientadas à segurança. Por isso, a atuação de análise e pesquisa independentes é crítica para antecipar riscos e validar controles.

Mesmo com a mitigação da técnica específica identificada, o risco estrutural permanece. Vetores como engenharia social, phishing e upload de arquivos maliciosos continuam sendo caminhos viáveis para ataques baseados em injeção de prompts e acesso indevido a dados.

Nesse contexto, torna-se indispensável que as organizações adicionem suas próprias camadas de proteção. A abordagem inclui políticas de prevenção contra vazamento de dados, monitoramento de rede e detecção de ameaças emergentes, além de mecanismos para reduzir riscos associados à manipulação de prompts.

Assim, conforme as plataformas evoluem, a superfície de ataque também se expande. Empresas que estruturarem desde já uma arquitetura robusta de segurança para IA estarão mais preparadas para mitigar riscos e sustentar a inovação com resiliência.

Fonte: Checkpoint

Clique e fale com representante oficial Cibercoah

Clique e fale com representante oficial Cibercoah

Veja também:

- Ataques com IA estão transformando a estratégia de backup nas empresas

- 7 passos para tornar sistemas cloud-native mais seguros em 2026

- Impacto das regulamentações de Cibersegurança do BACEN e da IN 09/2026

- Hiperpersonalização dos ataques digitais

- Vulnerabilidades e riscos IoT podem expor pedágio free flow no Brasil

- A IA que ataca

- Inscrições para o programa GRATUITO CiberEducação da Cisco terminam neste domingo (29)

- Pressão de ciberataques impacta a continuidade operacional de fábricas na América Latina

- 90% dos ciberataques são evitáveis

- Curso de AI gratuito em Harvard

- Novo grupo de ransomware “The Gentlemen”

- IA aplicada à cibersegurança muda a lógica da detecção e resposta em cloud

Be the first to comment